余昌黔

构建能看、能懂、能创造的多模态 AI。

我在快手可灵AI带领 可灵图片多模态生成 团队,构建视觉理解与生成的多模态基座模型。研究方向聚焦 Diffusion 模型和视觉语言模型。华中科技大学博士(🏆 CSIG 全国优博),连续三年斯坦福全球前 2% 顶尖科学家。

经历

在快手可灵AI带领 Kling-Image-Omni 团队,构建大规模视觉生成与理解产品。核心交付包括 Kling-Image-O1——将视觉推理引入图像生成,以及 Kling-Image 3.0 & 3.0 Omni,可灵AI最新一代图像基础模型。

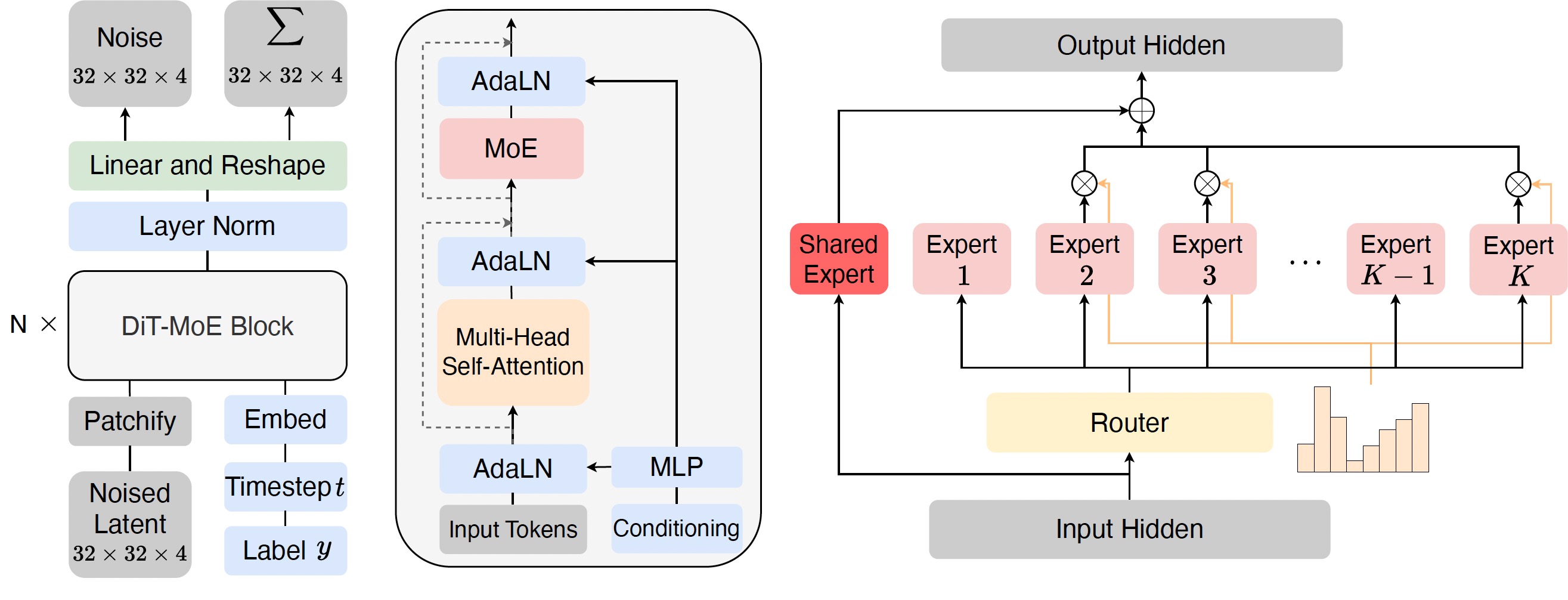

在昆仑万维(天工)主导多模态 AI 研究。交付了 Skywork-VL-32B 视觉语言模型,以及 SkyReels 中的分镜生成大模型,驱动影视级镜头规划。同时构建了可扩展的 Diffusion(MoE)训练流水线,支持文生图。

在美团自动配送部担任研究科学家,为自动配送车队开发轨迹预测和运动规划模型。提出的基于 Transformer 的预测模型部署在真实配送车上,服务百万级订单。

开源项目

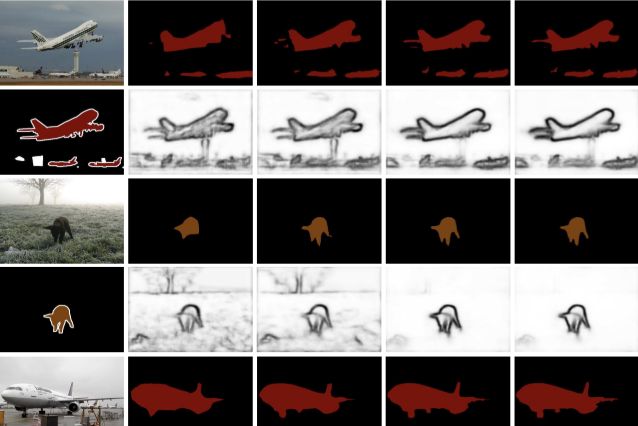

- VQRAE [paper] — 面向多模态理解、生成与重建的表征量化自编码器。

- SkyReels-V1 — 以人为中心的视频基座模型。2700+ ⭐

- SkyReels-A1 [paper] — 基于视频 Diffusion Transformer 的表情肖像动画生成。500+ ⭐

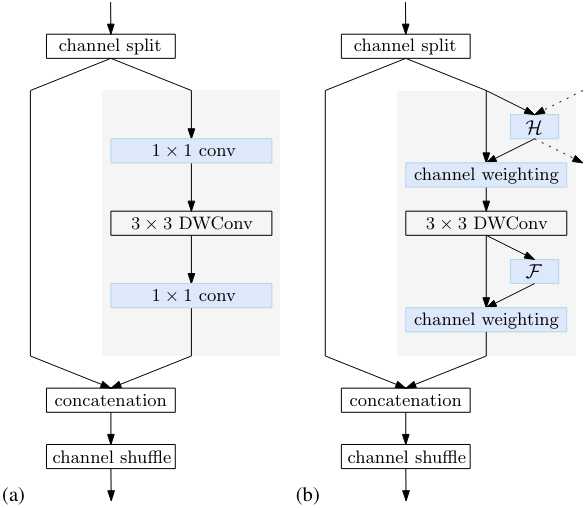

- LiteHRNet [paper] — 轻量级高分辨率网络。900+ ⭐

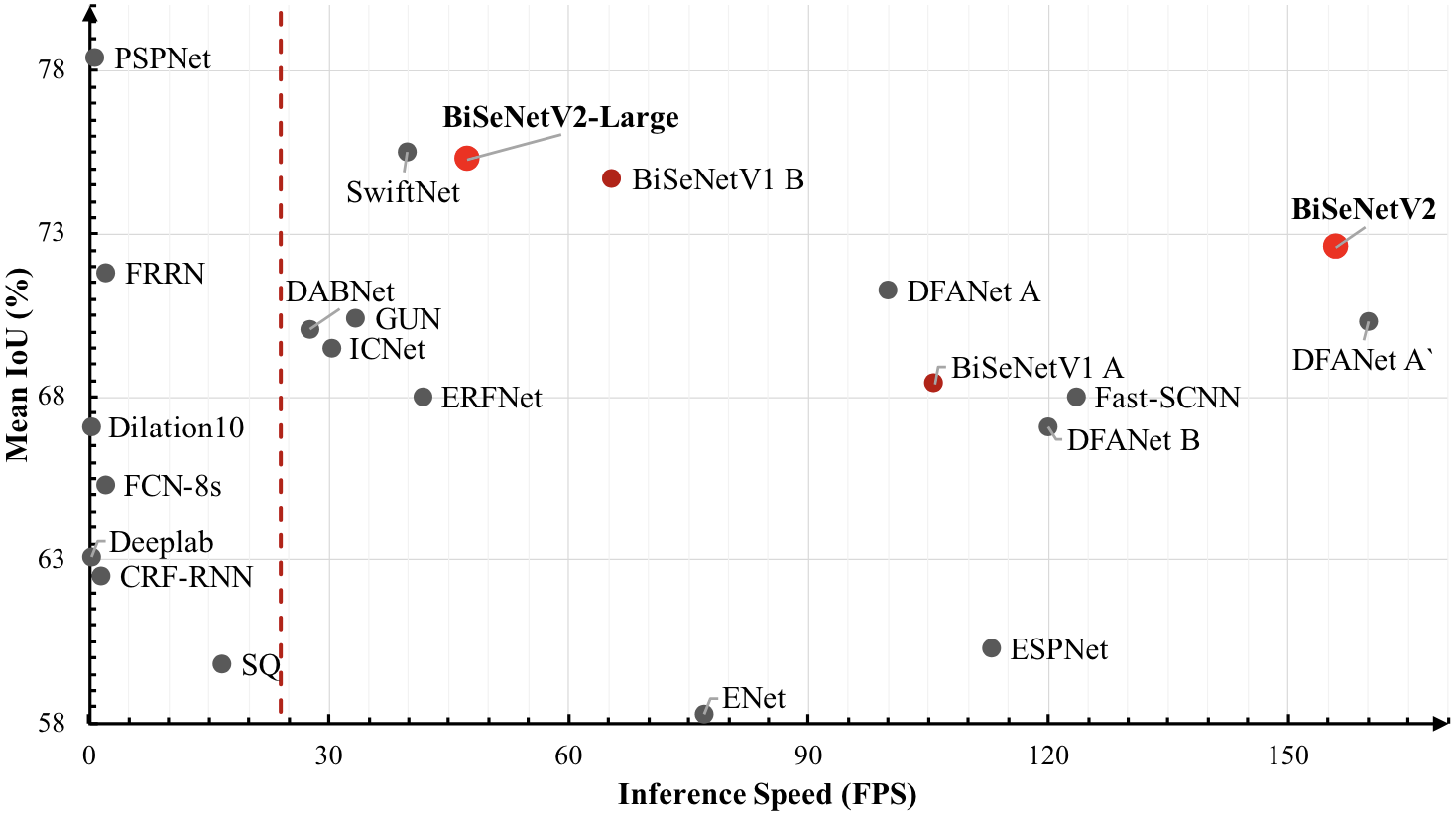

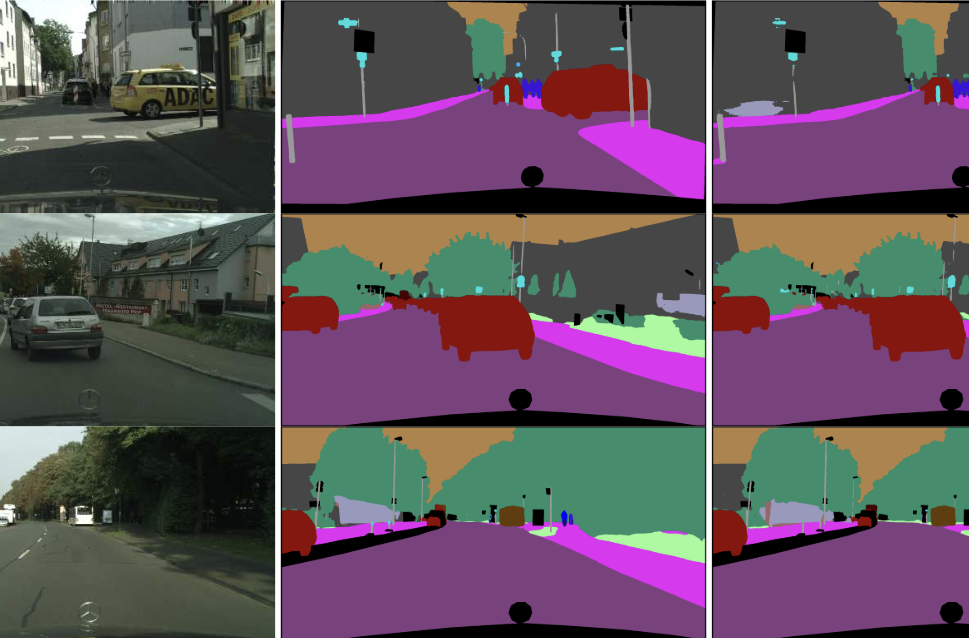

- TorchSeg — PyTorch 语义分割代码库 — BiSeNet、DFN、DenseASPP 等。1400+ ⭐

代表论文

查看全部 →

最新博客

查看全部 →

动态

-

2025

论文 VQRAE 被 CVPR 2026 录用。

-

2025

论文 CoTyle 被 CVPR 2026 录用。

- 2025